→ tamama000 : 可以請AI幫我總結10字以內嗎 04/07 00:38

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 00:39:52

賣掉其他六巨頭,等崩盤後全力買GOOGLE

台灣就買可以拿到他代工的跟GG

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 00:40:47

推 s8911090 : 內文都在講google 但語氣卻是chatgpt04/07 00:41

→ Brioni : PC黃金時代再錄音?04/07 00:42

→ Brioni : 再臨04/07 00:42

推 benen : google最近很勤勞啊,不是還大力推薦自家若有老電04/07 00:44

→ benen : 腦,可以改用chrome os再戰幾年 04/07 00:44

→ perlone : 記憶體又要缺貨了04/07 00:45

推 sdbb : 歐印GGLL最快04/07 00:46

推 miloisgood : 這樣機器人會先飛天吧04/07 00:47

基本上用一個還可以得有NPU的旗艦機可以寫app 來拓展的話

或著pi系列 做核心不難,難的是電機持久度,跟瞬時反應

推 bcismylove : 總結 歐印GOOGLE04/07 00:49

推 niniko : 好,買GOOX04/07 00:49

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 00:50:57

推 ga278057 : 有終端機器人嗎04/07 00:52

推 offstage : 可以請AI告訴我明天要買漲還是買跌嘛04/07 00:53

推 brightest : 問題是壹般人還是不知道ai除了能看廢片能幹嘛04/07 00:53

推 jack55777100: 總結就是google是神要歐印04/07 00:54

→ JoeyChen : 照AI社群的開發熱情 所有的可能性都會比預測的快吧 04/07 00:55

推 bobboy8755 : 可以離線畫色圖吃到飽的意思嗎?(興奮04/07 01:00

生成圖還要一下下 擴散模型比較麻煩

→ kuninaka : 又是AI生成的文章04/07 01:01

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:02:38

推 SodaMan : 夢裏都有,成本不是消失是轉嫁到其他費用 04/07 01:06

→ bollar7 : google要漲了嗎,好像沒... 04/07 01:06

→ SodaMan : 如果你理解AI 架構,就不會寫出這種結論 04/07 01:07

純推論應該還好 終端版本跟OS一樣持續更新釋出就好

推 BC0710 : 可以考慮一下GPU+WEKA/VAST 只能說都還未必誰贏 但 04/07 01:08

→ BC0710 : 餅越來越大是一定 04/07 01:08

→ aloness : 終端應用,尤其手持產品的天敵就是耗電量 04/07 01:09

(鼓掌

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:11:29

→ aloness : 下一個問題則是權限,誰會喜歡背景程式吃掉一大堆04/07 01:12

→ aloness : 資源,跟BT下載不會給手持3C一樣概念04/07 01:12

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:17:01

→ Obama19 : 想太多了 終究只是個chatbot04/07 01:15

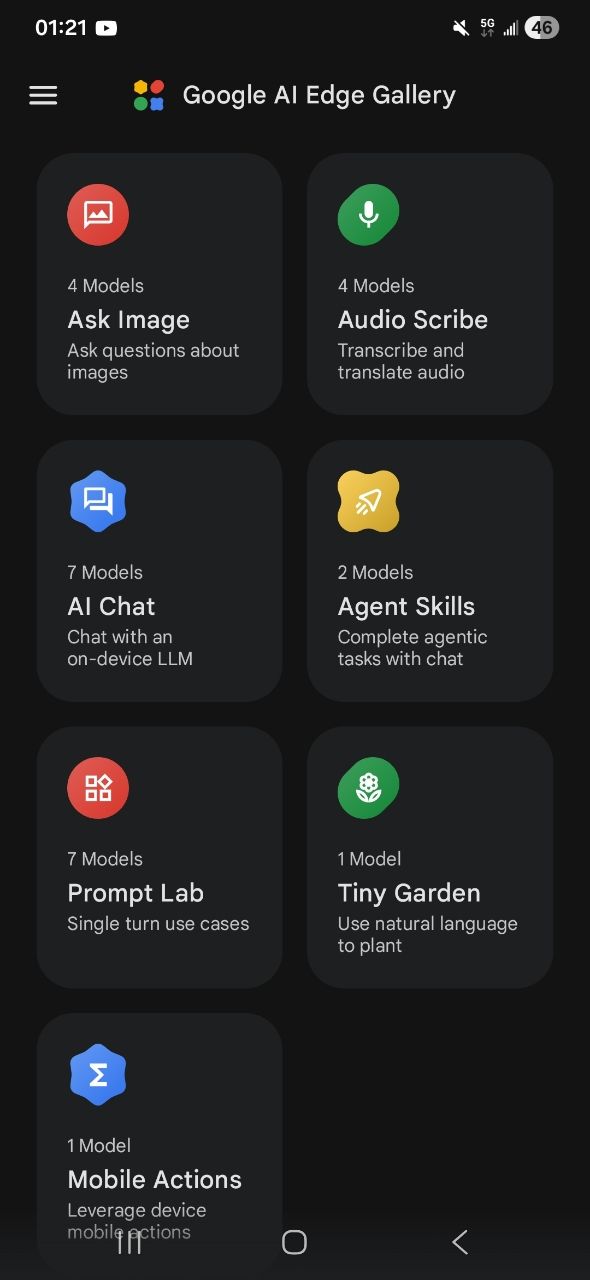

openclaw可以做到的,我都可以開發後在手機上做到一樣的事情,光是Google AI edge

garlley就開放了下面這些給你體驗了

https://i.mopix.cc/1cdBfD.jpg

噓 strlen : 第一天就載了 以一般消費者能裝的版本 基本沒屁用04/07 01:29

→ strlen : 又不是人人標配5090 就算是5090 模型也跟腦殘一樣 04/07 01:29

這跟5090沒有關係啊

光是 s24u 也滿普通的

→ strlen : 更別說agent功能 想太多 再等5年04/07 01:29

→ SodaMan : 推論的基礎是背後的參考資料,你無法帶著龐大的資 04/07 01:30

→ SodaMan : 料落地,那就是假像而已04/07 01:30

蒸餾跟微調剪枝以後的slm完全就是本體

....哪裡需要什麼參考資料,這跟RAG不一樣

這是已經訓練好,蒸餾各種功能的模型

,你不會在手機上做微調的,手機上要實作

RAG也不會難,以我這支手機512g的硬碟空間可以放專屬的KM了,終端場景需要什麼龐大

的資料,還是沒有辦法想像,最多做個即時聯網或是連網的資料存取api透過網路加載

跟google地圖一樣而已....

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:39:32

推 xzero0911 : 5090跑31B VRAM還不夠用 掛OLLAMA要64G 04/07 01:37

→ xzero0911 : 26B效果倒是真的不錯回應又快04/07 01:37

70%的商業應用場景其實不需要模型的多數能力啊,這點終端上本來有的能力結合起來這

個AI核心就好了。

→ yunf : 浪費時間寫那麼多廢話幹嘛?04/07 01:37

因為玩的滿興奮的

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:41:56

→ yunf : 續航力問題沒辦法解決講再多你也只是空談 04/07 01:40

推 furture84 : 有消息稱google的演算法是抄襲某研究生,而研究生04/07 01:48

→ furture84 : 的演算法是開源的04/07 01:48

→ furture84 : Rabbit 04/07 01:48

→ furture84 : RabitQ 04/07 01:48

→ SodaMan : 不要離題了,模型蒸餾目的是節省算力成本,這不代 04/07 01:49

→ SodaMan : 表著可以用低成本建置地端的AI ,知識蒸餾只是走了04/07 01:49

→ SodaMan : 捷徑並不是捨去成本04/07 01:49

推 lnonai : MTK:04/07 01:52

推 magic543 : 實際測試過 小模型沒多大屁用 直接用線上AI就可以04/07 02:00

→ magic543 : 真的要辦公 還是需要PC 唯一重點是記憶體真的被錯殺04/07 02:01

噓 haley80208 : 整天吹 所以發布會的即時翻譯什麼時後能做好 04/07 02:03

推 waitrop : 為何會提到蒸餾?谷歌這技術跟edge 端AI 跟蒸餾完 04/07 02:04

→ waitrop : 全沒有關係,簡單說就是模型小到能在edge 執行,效04/07 02:04

→ waitrop : 能又超強,跟蒸餾無關04/07 02:04

前兩代都是蒸餾的啊...

都是從teacher學習部分能力啊..

推 hc20016 : 結論就是 需要很多很多的記憶體 04/07 02:06

→ hc20016 : 記憶卡蛙團結強大 一張不賣 04/07 02:06

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 02:08:53

推 qoojo2002 : 現在買甲骨文很便宜 04/07 02:29

推 saito2190 : 我覺得邊緣裝置AI重點會在Agent能力跟指令服從性, 04/07 02:35

→ saito2190 : 他本身不用太聰明沒關係,反正Skill時代都是拿已經 04/07 02:35

→ saito2190 : 寫好的Skill給他跑,他只要能在正確的時間調用正確 04/07 02:35

→ saito2190 : 的工具,那就能完成大部分的任務,真正需要深度思 04/07 02:35

→ saito2190 : 考+研究的再去調用外部大模型就好 04/07 02:35

噓 holysong : 一隻手機20萬? 04/07 02:43

推 nineflower : 終端AI現在就能做阿,很佔地方而已,手機終端還要等 04/07 02:51

→ nineflower : 硬體奇異點突破 04/07 02:51

推 bala045 : 不是oooo 而是xxxx 可不可以讓你AI 不要再生這種句 04/07 02:52

→ bala045 : 子 04/07 02:52

→ zero790425 : 在吹估狗卻用別家AI填充內文 bad 04/07 03:07

→ sonatafm2 : 所以沒那麼快落實到手持裝置的 04/07 03:15

推 TameFoxx : 無論怎搞 你的電費都還是比雲端API還貴 04/07 03:28

→ budaixi : == 消費性電子股價都跌爛了,就你在吹 04/07 03:44

→ kingofsdtw : 增加手機耗電嗎? apple笑而不語 04/07 04:08

噓 space20021 : 你這篇也是AI寫的 04/07 04:22

→ CH1SIR : 置板凳! 04/07 04:35

→ CH1SIR : 五年後再回來這篇 04/07 04:35

推 kkman2 : 覺得遲早的事情 04/07 04:56

→ mtmmy : Mac Mini 16G RAM跑Gemma 4還是好吃力 04/07 05:16

推 breathair : 谷歌這版本基本就是給開發者玩的,看能玩出什麼花樣 04/07 05:23

→ breathair : ,有人調整權重讓他接受一些惡意指令(駭客攻擊), 04/07 05:23

→ breathair : 有人把它拿進公司封閉環境裡面做工作流自動化,綁定 04/07 05:23

→ breathair : 開發者生態,目的是為了搶佔開發者生態為目的 04/07 05:23

→ breathair : 日後終端算力肯定越來越高,模型越做越小。那個時候 04/07 05:23

→ breathair : 這東西就有機會成為可以裝在所有終端的安卓2.0(絕 04/07 05:23

→ breathair : 對不是現在,現在在手機上還不如免費版的Gemini) 04/07 05:23

→ breathair : 我買了許多谷歌,但谷歌現階段真不看這東西,他最重 04/07 05:25

→ breathair : 要的業務一樣是廣告跟大模型能力來保護自己的搜索業 04/07 05:25

→ breathair : 務,這只是眾多佈局中的一個細分賽道 04/07 05:25

推 cy168 : 沒有open ai,google 當初並不想推llm ai,因為商 04/07 05:36

→ cy168 : 業獲利整個被侵蝕。現在又準備建構讓大家離不開的 04/07 05:36

→ cy168 : 生態鏈了。 04/07 05:36

噓 alice1967 : 共享的資源還是最經濟實惠的,終端只是最後輸出跟顯 04/07 05:37

→ alice1967 : 示工具,別想太多! 04/07 05:37

→ guanting886 : SLM配點RAG最多只能做到志工媽媽角色 04/07 06:13

→ guanting886 : 能做小就幾個方向 縮小參數量、量化精度損失的部分 04/07 06:17

→ guanting886 : 就你看你調效的取捨 04/07 06:17

→ guanting886 : 上下文的能吃的量就決定他能做的事很有限了 04/07 06:18

推 vovovolibear: 你的眼光很棒,只是目前我們連夏天有沒有油可以發電 04/07 06:55

→ vovovolibear: 都不知道 04/07 06:55

推 zenixls2 : meta的llama當初被吹多高,你真的覺得本地端模型炒 04/07 07:14

→ zenixls2 : 得起來? 04/07 07:14

→ zenixls2 : esp32接大模型表現比Mac m3,4跑本地端模型好時,你 04/07 07:20

→ zenixls2 : 還想用本地端嗎? 04/07 07:20

推 mdkn35 : 早就有了吧 就準確率問題 04/07 07:24

推 efkfkp : 所以google到底還能不能買?有翻倍的可能嗎?還是股 04/07 07:31

→ efkfkp : 價就這樣了 04/07 07:31

→ wed1979 : 算力中心一直建,是有什麼應用已經落地需要大算力.. 04/07 07:34

→ wed1979 : .sora不是燒完了 04/07 07:34

→ CYL009 : 之前豆包手機就是了 只不過會被其他大企業抵制 看谷 04/07 07:38

→ CYL009 : 歌怎麼玩 04/07 07:38

噓 gaussjordan : 你哪位 04/07 07:45

推 solarpower : 感謝分享與測試~謝謝 04/07 07:47

推 john801110 : 阿斯拉? 04/07 07:52

推 roiop710 : 好的看來壓身家衝記憶體了 04/07 07:52

噓 fajita : 吹成這樣,看了都覺得好笑,跟那個死臉AI一樣 04/07 07:54

噓 jas258 : 這種 這不是…而是的文體是不是都是AI啊 04/07 07:59

推 secrectlife : 好像廢話太多了 04/07 08:11

推 ahg : 普遍消費者用與不用的差別?這滲透率跟商轉能這麼 04/07 08:12

→ ahg : 樂觀? 04/07 08:12

推 CCH2022 : 要多久才能twitch YouTube直播做到即時翻譯 04/07 08:18

噓 alice1967 : 你要知道公司靠什麼收費,是廣告不是手機,既然如此 04/07 08:26

→ alice1967 : ,搞終端就是傻子,沒有收入搞個屁!不要淨用AI寫幻 04/07 08:26

→ alice1967 : 想文 04/07 08:26

推 ikariamman : 台灣早有啦 04/07 08:33

噓 Porops : 有夠AI的文章,業內的根本不可能有這樣的結論 04/07 08:45

→ ma721 : 電池沒解決前都不可能 04/07 08:53

推 orange7986 : 我用 Mac Mini m4 pro 跑8B 模型很快但很笨 30B跑 04/07 09:15

→ orange7986 : 超慢…還是用雲端好 04/07 09:15

推 joygo : 沒噴就是跑起來其實還好 04/07 09:22

→ joygo : 出了之後就下載的心得是 如果你拿去買顯卡的錢 調 04/07 09:23

→ joygo : 閱應該很夠了 老黃越出token只會越便宜 04/07 09:23

![[新聞] 川普再批北約重申想併吞格陵蘭 韓澳日盟 - 股票 - PTT.BEST 批踢踢爆文](https://i.meee.com.tw/hC3mVOL.jpg)

![[新聞] 川普再批北約重申想併吞格陵蘭 韓澳日盟 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.verb.tw/OnXQQwFW.jpg)

![[新聞] 川普:該由美國收荷姆茲海峽「通行費」 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.verb.tw/PLmqyR1N.jpg)

![[新聞] 川普:該由美國收荷姆茲海峽「通行費」 - 股票 - PTT.BEST 批踢踢爆文 3](https://i.imgur.com/6ixx0eX.png)

![[情報] 5289宜鼎3月營收 mom+35.7% yoy+403% - 股票 - PTT.BEST 批踢踢爆文](https://i.imgur.com/v2TOSmI.jpeg)

![[閒聊] 2026/04/07 盤中閒聊 - 股票 - PTT.BEST 批踢踢爆文](https://pbs.twimg.com/media/HFO6_OEa8AAchru.jpg)

![[閒聊] 2026/04/07 盤中閒聊 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.imgur.com/te4ahzc.jpeg)

![[閒聊] 2026/04/07 盤中閒聊 - 股票 - PTT.BEST 批踢踢爆文 3](http://i.imgur.com/R8DRBhz.jpg)

![[新聞] 美伊和談等結果 川普拋美國在荷莫茲海峽 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.imgur.com/fTQYtxE.png)

![[新聞] 邊打仗邊上漲!韓股重返5500大關、日股盤 - 股票 - PTT.BEST 批踢踢爆文](https://i.imgur.com/bV9Jf9n.jpeg)

![[新聞] 特朗普:「伊朗他們就是一群禽獸」 - 股票 - PTT.BEST 批踢踢爆文](https://i.mopix.cc/ToueNV.jpg)

![[新聞] 特朗普:「伊朗他們就是一群禽獸」 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.meee.com.tw/DxFFdrQ.png)

![[新聞] 特朗普:「伊朗他們就是一群禽獸」 - 股票 - PTT.BEST 批踢踢爆文 3](https://i.imgur.com/lAReMUV.jpg)

![[新聞] 伊朗拒絕美國停火提案 - 股票 - PTT.BEST 批踢踢爆文](https://i.mopix.cc/A6CdVV.jpg)

![[新聞] 伊朗拒絕美國停火提案 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.mopix.cc/uCwcay.jpg)

![[新聞] 白宮證實正在考慮與伊朗停火45天提案 - 股票 - PTT.BEST 批踢踢爆文](https://i.urusai.cc/AI3p4.jpg)

![[新聞] 白宮證實正在考慮與伊朗停火45天提案 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.meee.com.tw/8Crjtjr.jpg)

![[新聞] 伊朗資金命脈最大石化設施遭轟炸 「能源 - 股票 - PTT.BEST 批踢踢爆文](https://i.imgur.com/TkFk13w.png)

![[新聞] 伊朗資金命脈最大石化設施遭轟炸 「能源 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.imgur.com/pcXxuih.png)

![[新聞] 伊朗資金命脈最大石化設施遭轟炸 「能源 - 股票 - PTT.BEST 批踢踢爆文 3](https://i.imgur.com/cYEpaTT.png)

![[新聞] 川普死了謠言瘋傳!多天未公開露面 白宮 - 股票 - PTT.BEST 批踢踢爆文](https://i.imgur.com/2BpHNYS.jpeg)

![[新聞] 川普死了謠言瘋傳!多天未公開露面 白宮 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.imgur.com/bjm8K0K.jpeg)

![[新聞] 川普死了謠言瘋傳!多天未公開露面 白宮 - 股票 - PTT.BEST 批踢踢爆文 3](https://i.imgur.com/6hF3McQ.jpeg)

![[新聞] 美伊討論45天停火協議 伊朗拒以重啟荷莫 - 股票 - PTT.BEST 批踢踢爆文](https://i.mopix.cc/dxyTCq.jpg)

![[新聞] 台股7日開盤安了?傳美伊停火協議出爐 - 股票 - PTT.BEST 批踢踢爆文](http://i.imgur.com/Xc7PIQL.jpg)

![[新聞] 台股7日開盤安了?傳美伊停火協議出爐 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.mopix.cc/zv1hFa.jpg)

![[新聞] 元大台灣50正2分割後門檻大降 交易量暴增 - 股票 - PTT.BEST 批踢踢爆文](https://i.imgur.com/XSIZsL7.jpeg)

![[新聞] 元大台灣50正2分割後門檻大降 交易量暴增 - 股票 - PTT.BEST 批踢踢爆文 2](https://i.imgur.com/CGItDIO.jpeg)

![[新聞] 元大台灣50正2分割後門檻大降 交易量暴增 - 股票 - PTT.BEST 批踢踢爆文 3](https://imgpoi.com/i/HDNTUD.png)

![[新聞] 美伊停火協議內容曝!荷姆茲海峽立即解封 - 股票 - PTT.BEST 批踢踢爆文](https://i.imgur.com/x1Ei9hF.png)